スイス応用科学芸術大学(SUPSI)とイタリアのミラノ工科大学(Polimi)で行われた研究によって、ドラムスティックを握る人型ロボットが、自らリズムを学び、人間のような演奏テクニックを身につけることに成功しました。

研究においてロボットたちは多くの曲で正確率(F1スコア)90%前後を記録し、曲ごとの構造や複雑さに応じて動作を調整する柔軟性も備えていることも示されています。

今後、実機への移行が進めば、ロボットが人間と同じステージで演奏する日も近いかもしれません。

ロボットはどこまで「音楽のノリ」を理解できるようになるのでしょうか?

研究内容の詳細は2025年7月18日に『arXiv』にて発表されました。

目次

- 人型ロボットが奏でる新たなビート

- ロボが自ら見つけた演奏技術は人間とソックリだった

- なぜロボットは人間のように演奏し始めたのか?

人型ロボットが奏でる新たなビート

このロボットドラマーの登場は、SFのような空想ではなく、実際の研究成果として生まれたものです。

これまで人型ロボットは、荷物を運んだり高齢者を支援したりと、実用的な作業を手伝う目的で使われてきました。

これらの作業は「目的地に到着する」「物を運ぶ」といった、動きが一度で完結するゴール重視のタスクが中心でした。

一方、楽器演奏のような表現活動は、そうしたゴール型とは異なり、演奏中ずっと続くリズムや動きを保つことが大切な「プロセス重視型のタスク」です。

ドラム演奏の場合、瞬間ごとの正確なタイミングだけでなく、両手両足を別々に動かす全身の協調性、さらには音楽ごとのリズムのズレや、叩く太鼓の数の違いにも柔軟に対応する力が求められます。

つまり、時間的にも空間的にも複雑で、ロボットにとってはとても難しい挑戦なのです。

この分野はこれまであまり研究が進んでおらず、過去の研究ではピアノや簡単な打楽器のように、限られた範囲の動きだけに集中したものがほとんどでした。

そうした中で、スイス応用科学芸術大学(SUPSI)とIDSIA研究所、そしてイタリアのミラノ工科大学(Polimi)の研究チームは、「もし人型ロボットが音楽を演奏できたら?」という発想からこのテーマに挑戦しました。

なかでもドラム演奏を選んだ理由は、テンポの維持、広い範囲への腕の移動、そして全身の動きを同時に必要とするため、ロボットの動作学習にとって非常に良い訓練材料になるからです。

研究の目的は、強化学習と呼ばれるAIの学習手法を使って、さまざまな曲を安定したタイミングで演奏できるロボットの仕組みを作ることでした。

強化学習とは、うまくできた行動にはご褒美(報酬)を与え、失敗すれば減点することで、ロボットが自ら良い動きを覚えていく方法です。

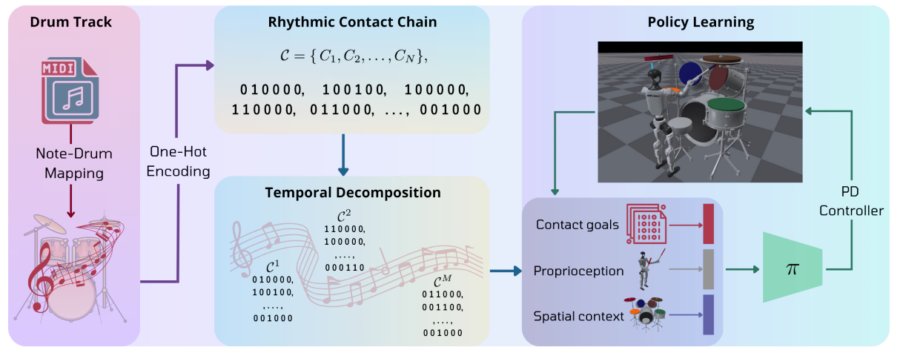

今回の研究では、楽曲の中で「いつ・どの太鼓を叩くか」という情報を、「リズミック・コンタクト・チェーン(RCC)」という形式に変換してロボットに与えました。

このRCCをもとにロボットが練習を重ねた結果、単に見本をなぞるのではなく、自分で効率のよい叩き方を工夫しながら、多くの曲を学んでいきます。

ロボットたちはいったいどんな過程を経て自然に人間らしい動きを獲得したのでしょうか?

ロボが自ら見つけた演奏技術は人間とソックリだった

研究チームはまず、開発した強化学習システム「Robot Drummer(ロボットドラマー)」が本当に演奏を学べるかどうかを試すため、安全かつ大量の試行ができるコンピューター上の仮想環境を使いました。この環境には、実在する人型ロボット「Unitree社製G1モデル」を再現したデジタルモデルとドラムセットが設置されています。

ロボットはこの中で、様々なドラム演奏をシミュレーションによって学習します。

演奏する楽曲の情報は、MIDI(ミディ)という形式のデータから取り出されます。MIDIとは「どの楽器が、いつ、どんな音を鳴らすか」という情報を記録した、デジタル譜面のようなものです。

そこからドラムのパートだけを抽出し、「この瞬間にどの太鼓を叩くか」という目標の列に変換します。

研究者たちはこの一連の打点の流れを「リズミック・コンタクト・チェーン(RCC)」と名付けました。

たとえば「次はスネアとシンバルを同時に叩く」といったように、ドラム演奏の動作を時間順に並べた“打撃スケジュール”のようなものです。

ロボットにはこのRCCに加えて、自分の腕や関節の角度、速度、ドラムとの位置関係といった身体感覚の情報も与えられます。

それらをもとに、「今の姿勢」から「次にすべき動き」をどうつなげるかを学習し、どの腕をどう動かせばうまく打点に間に合うかを試行錯誤しながら練習を積みました。

この学習は、8192体のロボットを同時にシミュレーション内で動かす並列環境で行われました。

曲をいくつかの区間に分けて覚える方式では、2〜3時間ほどで高い演奏精度に達し、曲全体を一括で学ぶ方式では8〜9時間かかりました。

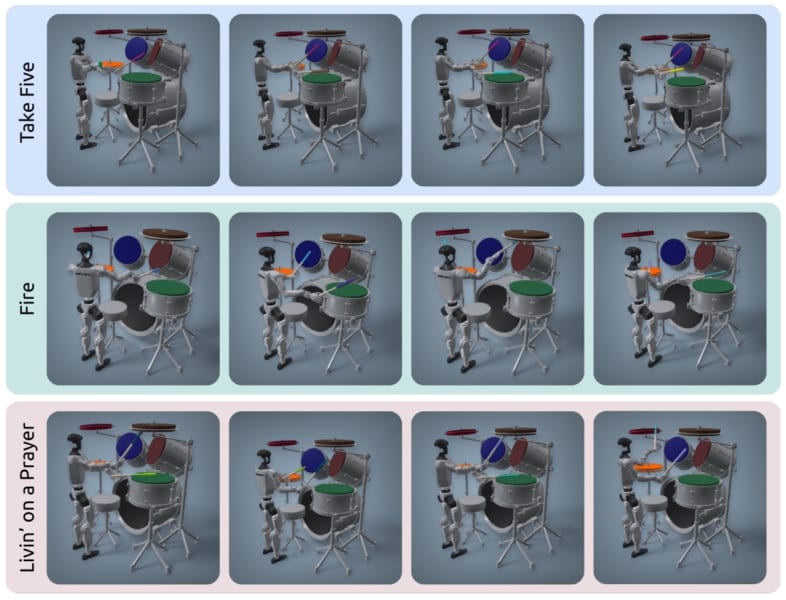

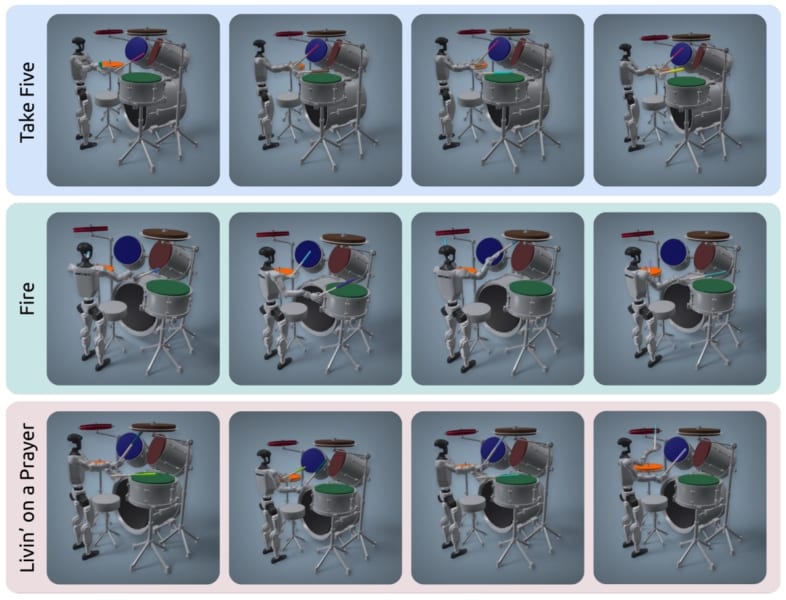

学習後、ロボットはジャズやロック、ヘビメタルといったさまざまなジャンルの楽曲でテストされました。

評価に使われた曲には、

「リヴィン・オン・ア・プレイヤー(ボン・ジョヴィ)」

「テイク・ファイブ(デイヴ・ブルーベック)」

「イン・ジ・エンド(リンキン・パーク)」

などが含まれています

その結果、多くの曲でF1スコアが0.90(90%)以上という非常に高い成績を記録しました。

F1スコアとは、正しく叩けていて、しかも叩き漏れがほとんどない演奏精度を示す指標です。(※ごく簡単に言えば正確率と言えるでしょう)

一方で「Paint It Black」は0.792、「Smells Like Teen Spirit」は0.712とやや低めで、これは3つ以上の同時打ちが必要な場面で、ロボットは2打までしか同時に叩けないという物理的な制約によるものです。

さらに注目すべき点は、ロボットが報酬の設計だけから「人間らしい演奏の工夫」を自分で生み出したことです。

報酬のルールは、「正しいタイミングで叩けば加点」「間違いや打ち漏れは減点」「目標に近づくと加点」といったシンプルなものです。

それでもロボットは、交差打ちやスティックの持ち替えといった演奏テクニックを自然に身につけました。

たとえば、右側にあるシンバルを叩く直前に、前のスネアを左手で処理するという動きが観察されました。

これは右手を空けておくことで、次の打点にすばやく移動できるようにした工夫です。

このように、リズムの乱れを防ぎつつ効率よく叩ける戦略をロボットが自ら見つけ出したのです。

なぜロボットは人間のように演奏し始めたのか?

今回の研究は、AIとロボット工学によって、人型ロボットが自分の力で創造的なスキルを身につけられることを示した点で、大きな意義があります。

特にドラム演奏のように、一瞬ごとのタイミングが正確に求められる表現的な作業を、ロボットが自律的にマスターしたことは注目に値します。

これまでの産業用ロボットやエンタメ向けロボットの多くは、人間があらかじめ動きをプログラムし、それをただ再生するものでした。

しかし今回のロボットドラマーは、演奏の目標だけを与えられた状態で、自分自身で繰り返し練習を重ね、曲のリズム構造や複雑さに合わせて体の動きを柔軟に調整することができるようになりました。

これは、将来的にロボットがバンドメンバーの一人として、人間と一緒にステージで生演奏を披露する未来を想像させる成果です。

研究チームの一人は、「学んだ技能を実際のロボットに移すのが次のステップ」と語っており、現在はシミュレーションで身につけた演奏スキルを、実際の人型ロボットに移し替える準備が進んでいます。

もし本物のドラムセットを叩けるようになれば、ライブで人間とロボットが共演する姿が近い将来見られるかもしれません。

【コラム】なぜロボットドラマーは人間のような動きを自然と獲得したのか?

人間のドラマーが演奏中に見せる腕の交差やスティックの持ち替えは、長年の経験や身体感覚の積み重ねから生まれる「工夫」に見えます。しかし今回の研究で登場したロボットドラマーは、それらを誰からも教わらずに自然と身につけました。この背景には、単なる模倣ではなく、「次の一打をどう効率よく叩くか」を常に考える仕組みが深く関わっています。ロボットは曲全体を通じて、限られた時間の中で遠く離れたドラムやシンバルに素早く手を伸ばす必要があります。そのため、今の一打をどう打つかが、数秒先の動作にまで影響します。研究では、未来の打点情報と密な報酬設計を組み合わせることで、ロボットが「次の動作を見越した計画」を立てられるようになりました。この未来志向の動きは、効率的に目的地へ向かうための経路探索の結果として生まれ、人間が自然に行う段取りと驚くほど似通っていたのです。例えば、右手で叩くのが基本のスネアも、その直後に右側のシンバルを叩く必要があれば、あえて左手で処理して右手を温存します。こうした選択は、事前にプログラムされた振る舞いではなく、演奏全体の流れを最適化するためにロボット自身が編み出した戦略です。言い換えれば、ロボットは楽譜を“読む”だけでなく、演奏中の制約と先の展開を同時に考えるようになったのです。このようにして生まれた「人間らしい動き」は、偶然ではなく、時間的文脈と空間的計画を結びつける学習プロセスの必然といえます。そしてこのアプローチは、単なる演奏スキルにとどまらず、将来的には他の複雑な協調作業や創造的動作にも応用できる可能性を秘めています。

さらに、この技術は音楽以外の分野にも応用が期待されています。

たとえば、リズムに合わせて正確に動く能力は、スポーツやダンス、リハビリテーション、または工場のライン作業など、タイミングが重要な多くの場面で役立つ可能性があります。

研究チームは今後、ロボットに即興演奏やスタイルの切り替えといった、固定された譜面を超える創造的な力を学ばせることも計画しています。

つまり、その場その場の音や仲間の演奏に合わせてリズムを変える、「音楽のノリを感じて動く力」をロボットに身につけさせたいというのです。

また、論文では演奏精度に影響する要因についても詳しく分析されています。

特に「使用するドラムの数(空間的な複雑さ)」や「打点の時間間隔の不規則さ(nPVI)」が大きい曲では、ロボットの成績(F1スコア)がやや低くなることが確認されました。

これは、叩く場所やタイミングの切り替えが激しいほど難しくなるためです。

一方で、テンポの速さやドラムの使い分けの多さ(エントロピー)は、それほど成績に影響しないこともわかりました。

こうした知見は、今後さらに賢く、柔軟に演奏できるロボットを開発していくうえで、貴重なヒントとなります。

人型ロボットが自分の力でドラム演奏を学び、しかも人間のような演奏の工夫まで身につけたという事実は、かつては夢物語のように思われていました。

しかし今、AIの進歩によってその夢は現実になりつつあります。

近い未来、ステージの上で、情熱的なビートを叩き出すロボットを観客が拍手で迎える――そんな光景が当たり前になる日が訪れるかもしれません。

元論文

Robot Drummer: Learning Rhythmic Skills for Humanoid Drumming

https://doi.org/10.48550/arXiv.2507.11498

ライター

川勝康弘: ナゾロジー副編集長。 大学で研究生活を送ること10年と少し。 小説家としての活動履歴あり。 専門は生物学ですが、量子力学・社会学・医学・薬学なども担当します。 日々の記事作成は可能な限り、一次資料たる論文を元にするよう心がけています。 夢は最新科学をまとめて小学生用に本にすること。

編集者

ナゾロジー 編集部