WEELメディア事業部リサーチャーのいつきです。

最近注目を浴びている生成AIで自社業務を効率化したいと考えるも、情報漏洩などのリスクがあることにより、導入を見送っている企業も多いのではないでしょうか。

そんなときは、ローカルLLM(ローカル生成AI)の出番です。ローカルLLMの導入には以下のようなメリットがあります。

- データのセキュリティとプライバシーが担保できる

- レスポンスタイムの短縮

- コストの削減

- コンプライアンス要件への対応

- インターネットに接続できない環境でも利用可能

最後までお読みいただくと、ローカルLLMの基本やメリット、使い方を把握できます。自社に適したローカルLLMを導入でき、業務効率化につなげられるでしょう。

LLMの基本

生成AIが注目されて以来、LLMというワードもよく耳にするようになりました。チャットボットなど、私たちの身近なところでLLMを活用したサービスが急速に普及しています。

最初に、生成AIの主要な要素の一つであるLLMの基本をまずは押さえておきましょう。

LLMとは

ChatGPTなどの生成AIで使われているのは、LLM(Large Language Model:大規模言語モデル)と呼ばれるAIモデルです。LLMは一般的に膨大な数のパラメータを持ち、大量のデータで学習することで、文脈を高い精度で理解し、高度な文章を生成する能力を備えています。

この特性を活かし、文章の生成、要約、言語翻訳、質問への回答など、多様な領域での活用が進んでいます。

LLMの利用方法には大規模なクラウド環境で運用するクラウド型と、個人のPCや企業のサーバーで運用するローカル型があります。用途やセキュリティ要件に応じて、適切な方法を選択できます。

クラウド型LLMとローカル型LLMの違い

LLMの利用法には、クラウド型とローカル型の2つの種類があります。それぞれ特徴が異なり、用途に応じて最適な方法を選択します。

クラウド型LLMは、インターネットに接続したPCからクラウドにアクセスしてLLMを利用するタイプです。代表的なものに、Open AIのChatGPTやAnthropicのClaudeなどがあります。

クラウド上で強力な計算資源を利用できるため、インターネットに接続したデバイスさえあれば高性能モデルも利用可能です。しかし、外部とのデータ送受信が必要であり、セキュリティ面での心配があります。

ローカルLLMとは、自社サーバーや個人のPC上で動作するLLMです。自社の管理する環境で処理が完結するため、情報漏洩の心配がほとんどありません。

社外秘の情報を生成AIに入力して処理させたいときは、ローカルLLMを使用すると漏洩リスクを低減できます。しかし、高速なGPUなどのハイスペックな環境が必要になるなど運用のハードルがクラウドに比べて高い傾向にあります。

なお、生成AIの法人利用方法を知りたい方は、以下の記事をご確認ください。

クローズドソースLLMとオープンソースLLM

LLMにはもう一つ別の観点での分類があり、クローズドソースLLM(Closed Source LLM)とオープンソースLLM(Open Source LLM)です。

クローズドソースLLMとは、個人や企業が単独で所有する独占的なAIモデルのことです。ChatGPTやClaude、Geminiなどが代表例であり、ソースコードが公開されていないため、開発したLLMが模倣されにくいメリットがあります。

一方、オープンソースLLMはソースコードが無償で一般公開されているLLMで、誰でも利用できることから機能開発が進みやすいのがメリットです。

利用する環境や企業の状況によって最適なLLMは異なります。適切なモデルの選定や導入後の最適化をサポートしてくれる専門家の助言を受けることで、スムーズに運用を開始できます。

ローカルLLMのメリット

ローカルLLMの導入には、企業の特定のニーズに応じた多くのメリットがあります。データの安全性を確保しながら業務効率を向上させるだけでなく、コスト管理や柔軟なカスタマイズも可能です。

以下はローカルLLMの主要なメリットの5つです。

データのセキュリティとプライバシー

ローカル環境でLLMを運用することで、データが外部に流出するリスクを最小限に抑えられます。機密性の高い情報を扱う場合や、データの外部送信が制限されている場合に有効です。

レスポンスタイムの短縮

ローカル環境での実行は、クラウド上のサービスと比べて通信の遅延がないため、リアルタイム性が求められるアプリケーションではレスポンスが速くなります。

コスト管理

クラウドベースのLLMサービスは従量課金制が一般的で、頻繁に使用する場合や大量のデータを処理する場合、コストが高額になることがあります。ローカル環境では初期コストはかかるものの、長期的にはコストを抑えられることがあります。

コンプライアンス要件への対応

業界によっては、データの扱いに関して厳格な規制が存在し、データを外部に送信することが禁じられている場合があります。ローカルでの運用はこれに対応する手段となります。

インターネットに接続できない環境でも利用可能

ネットワークが不安定な場所(医療現場や製造業など)でも、運用ニーズを満たすことができます。

これらのメリットにより、ローカルLLMは企業にとって信頼性の高い選択肢となります。特に、セキュリティが重要視される環境やコスト管理が求められる場面では、その効果を最大限に発揮するでしょう。

ローカルLLMやAI PC、ワークステーションの弊社事例は以下からご覧いただけます。

ローカルLLMの注意点

ローカルLLMを導入する際には、注意すべきポイントがあります。LLMによる業務効率化を狙っても、以下の要素を考慮しなければ、企業の信頼を落とすなど事業に致命的な悪影響をもたらす可能性もあります。

注意点を点を事前に理解し、対策を講じることで、より効果的にローカルLLMを運用できるでしょう。

ハードウェアの要件

ローカルLLMを実行するためには、相応のハードウェア性能が必要です。特に大規模なモデルの場合、GPUの性能が重要です。

十分な計算リソースがないと、モデルの動作が遅くなったり、正確な結果が得られなかったりする可能性があります。

導入前に必要なハードウェア要件を確認し、必要であればアップグレードを検討することが重要です。

メンテナンスとアップデート

クラウドベースのLLMと異なり、ローカルLLMのメンテナンスやアップデートは自社で行うか、外部の専門家に依頼する必要があります。

最新の機能を使いたい場合や、セキュリティパッチが必要な場合に、適切に対応できないとリスクが高まります。

定期的なメンテナンススケジュールを設定し、モデルや関連ツールのアップデートを確認・適用するプロセスを整備しておくことが重要です。

データの管理とセキュリティ

ローカル環境でLLMを運用することで、データのセキュリティは高まりますが、内部でのデータ管理においては依然として注意が必要です。

特に、モデルに供給するトレーニングデータや運用データの管理が不適切だと、セキュリティ上のリスクが発生する可能性があります。

トレーニングデータや運用データのアクセス制限を厳格にし、暗号化やバックアップなどのセキュリティ対策を講じることが求められます。

カスタマイズの複雑さ

ローカルLLMはカスタマイズ性が高い反面、適切な調整が行われないと、期待したパフォーマンスが得られないことがあります。特に、業務固有のニーズに合わせてモデルを微調整するには、技術的な知識と経験が必要です。

モデルのカスタマイズには、社内に専門知識を持った担当者を配置するか、外部の専門家に依頼することを検討するべきです。また、事前にテスト環境を用意し、カスタマイズの影響を確認することも重要です。

サポートの限界

クラウドベースのLLMでは通常、サービス提供者からのサポートが受けられますが、ローカルLLMではそのようなサポートが限定的であるか、自社で全てを管理する必要があります。これにより、トラブル発生時に迅速な対応が難しくなる可能性があります。

自社内での技術サポート体制を強化するか、信頼できる外部パートナーを確保しておくことが望ましいです。

ローカルLLMを導入する方法

ローカルLLMの導入は、以下の3ステップで簡単に完了します。

- ローカルLLMを実行するためのプログラムをインストールする

- LLMを自身のPCもしくは自社サーバーにインストールする

- 1でインストールしたプログラムで2のLLMを指定してプロンプトを入力する

ローカルLLMを自身のPCで動作させるためには、特定のツールが必要です。具体例として、Ollama・Open-webui・LM Studioなどがあります。

次に、タスクを処理するLLMを自身のPCにインストールしてください。ローカル環境で動作するLLMの代表例としては、Llama-3-ELYZA-JP-8B-AWQやStable Diffusionなどが有名です。

画像生成やコード生成など、インストールするモデルによって得意なタスクが異なるので、LLMの利用目的を明確にしたうえで選びましょう。

LLMを自身のPCにインストールしたあとは、1の手順で入手した専用プラグラム上でLLMを指定して、プロンプトを入力するだけで、LLMがローカル上で簡単に動作します。

日本語対応のおすすめローカルLLM

ここからはローカル環境で使えるおすすめのLLM12モデルの特徴や強みを解説していきます。ローカルLLMのモデル選択で悩んでいる方は参考にしてみてください。

Qwen2-72B-Instruct

Qwen2-72B-Instructは、アリババ社のQwenグループが開発している大規模言語モデルです。大規模な言語およびマルチモーダルデータが事前にトレーニングされており、視覚や音声理解等も可能にしています。

また、英語や中国語を含む27の言語でトレーニングされているのも特徴。複数言語が出現してしまうコード・スイッチングの現象も対策されています。

なお、Qwen2-72B-InstructをローカルLLMとして使う際は、インストールに料金が発生しません。ローカルLLMを無料で使いたい方は、ぜひチェックしてみてください。

Qwen2-72B-Instructについては、以下の記事で詳しく解説しています。

Command R

カナダのAIスタートアップ企業であるCohereは、Command RというLLMを開発しています。パラメータ数が35億のCommand Rに加えて、1,040億のCommand R+も利用可能です。法人向けを想定したLLMであり、日本語にも対応しています。

2024年7月には、富士通株式会社と戦略的パートナーシップを締結し、プライベート環境で利用できる日本語LLMを共同開発しています。※1

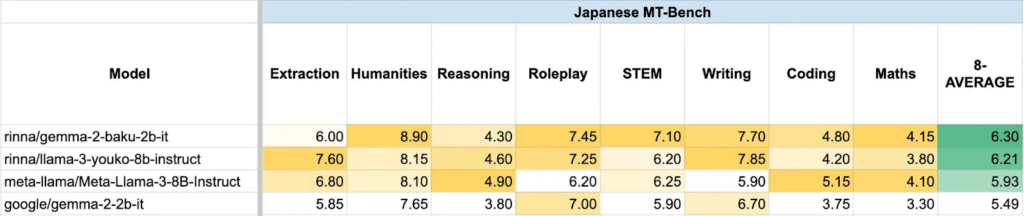

gemma-2-baku

gemma–2-bakuは、rinna株式会社が開発する高性能な日本語LLMです。Googleが公開しているLLM「Gemma 2 2B」に、日本語と英語の学習データ800億トークンを用いて継続事前学習を行っています。

gemm 2 baku の日本語性能は、各分野において高いスコアを示しています。

Gemma 2 2Bはパラメータ数が26億と比較的軽量ですが、高度なテキスト生成能力を持ちます。軽量なモデルはハイパフォーマンスな環境を必要とせず、導入が用意である点もメリットです。

また、追加学習も比較的容易なため、自社の目的に合わせてカスタマイズすることも可能です。

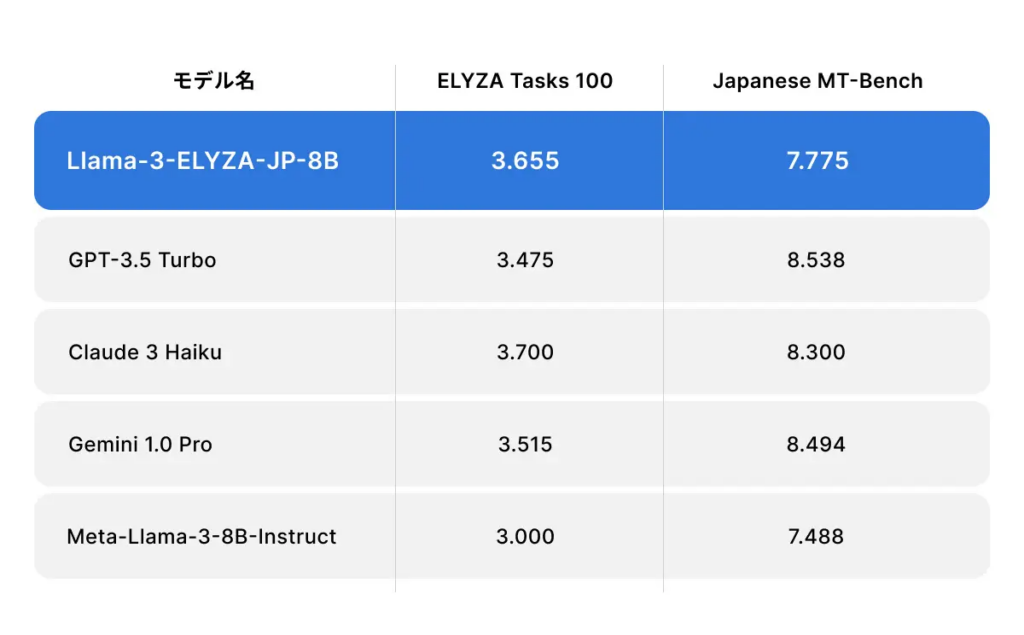

Llama-3-ELYZA-JP-8B-AWQ

Llama-3-ELYZA-JP-8B-AWQは、株式会社ELYZAがリリースした日本語特化型のLLMです。Meta社の「Llama 3」をベースとしながら、日本語とその周辺知識について多くのデータを学習させています。

モデルの量子化によりPCにかかる計算負荷が小さく、メモリ使用量も比較的少ないため、ハイスペックな環境でなくても動作可能です。

なお、日本語の処理能力においては、GPT-3.5 TurboやClaude 3 Haikuを超えているとのこと。そのほか、各種ベンチマークテストにおいて、名だたるLLMよりも高性能であることを証明しています。

日本語の出力や読み込み精度にこだわりたい方は、ぜひローカルLLMとして活用してみてください。また、モデルは一般公開されており、商業目的での利用が可能です。

CyberAgentLM

CyberAgentLMは、サイバーエージェント社が開発した日本語特化型のLLMです。膨大な日本語データでトレーニングされており、225億ものパラメータを備えています。

とくに、高い日本語処理能力を備えているのが特徴。微妙なニュアンスも理解して文章を生成できるので、丁寧な言葉遣いが求められるビジネスメールの作成などにも向いています。

ローカルLLMとしての利用が可能なほか、配布や商用利用等の目的で使用することも許可されているので、さまざまなニーズに対応できるのが強みです。

CyberAgentLMについて詳しく知りたい方は、以下の記事もチェックしてみてください。

StableLM

StableLMは画像生成AIのStable Diffusionでおなじみ、Stability AIが開発したローカルでも使えるLLMのシリーズです。歴代モデルは以下のとおりになります。(※2)

- StableLM-Alpha models(3B / 7B):日本語対応

- StableLM-Alpha v2(3B / 7B)

- StableLM-3B-4E1T(3B)

- Stable LM 2 1.6B

- Stable LM 2 12B

- Stable LM Zephyr 3B

- Japanese Stable LM 1.6B:日本語特化

どのモデルについても、Llamaアーキテクチャをベースに、パフォーマンスの最適化が行われている点が特徴です。

なお、StableLMについて詳しく知りたい方は、以下の記事をご確認ください。

Llama 3.3 Swallow

Llama 3.3 Swallowは、Meta社のLlama 3.3を基盤に、日本語能力を強化した70BのローカルLLMです。こちらは日本語理解・生成において優れたスコアを記録していて、GPT-4oに次ぐ性能を示しています。(※3)

なお、ベースのLlama 3.3について詳しく知りたい方は、以下の記事をご確認ください。

Gemma 3

Gemma 3は、Gemini 2.0をベースにGoogleが開発したローカルで動くLLMです。こちらは高い計算効率がアピールポイントで、GPU1個またはTPU1個で稼働させられます。以下のような用途で活躍してくれるでしょう。(※4)

- テキスト生成

- 推論

- コード解析

- 対話型タスク

また、クラウド環境でもスムーズに活用できるのも特徴です。

なお、Gemma 3について詳しく知りたい方は、以下の記事をご確認ください。

DeepSeek-V3

DeepSeekチームが開発したDeepSeek-V3は、ローカルでも動せるオープンソースLLMの最強格。以下の工夫がなされていて、なんとGPT-4oやClaude 3.5 Sonnetに匹敵する性能を誇ります。(※5)

- 14.8兆トークンのデータで事前学習済み

- Mixture-of-Experts(MoE)で処理を効率化

- ファインチューニング(SFT)と強化学習(RLHF)で最適化

- 独自の負荷分散戦略とマルチトークン予測目標も採用

中国発のLLMでありながら、日本語に対応しているのも特徴です。

なお、DeepSeek-V3について詳しく知りたい方は、以下の記事をご確認ください。

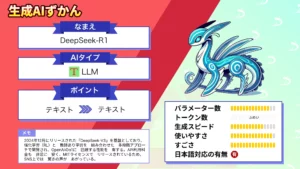

DeepSeek-R1

同じくDeepSeekチームのDeepSeek-R1は、ローカル&日本語対応の推論モデル(Chain-of-Thoughtを駆使するLLM)です。こちらは教師なし学習をフル活用して開発されていて、コストパフォーマンスが抜群。それでいて、数学・コード生成・推論…etc.のタスクでOpenAI o1に匹敵する性能を示しています。(※6)

なお、DeepSeek-R1について詳しく知りたい方は、以下の記事をご確認ください。

Mistral NeMo

Mistral NeMoは、MistralとNVIDIAが共同開発した12BパラメータのローカルLLMです。その特徴は以下のとおりで、日本語を含む多言語で高性能を発揮します。(※7)

- コンテキストウィンドウは128Kトークン

- 効率的なトークナイザー「Tekken」を採用

- 推論・知識・コーディングが得意

- 多言語対応で、韓国語やアラビア語などでも高性能

その性能は、Gemma 2 9BやLlama 3 8Bなどのライバルをも上回ります。

なお、Mistral NeMoについて詳しく知りたい方は、以下の記事をご確認ください。

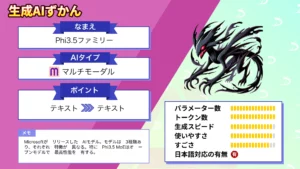

Phi-3.5-mini-instruct

Phi-3.5-mini-instructは、Microsoft製LLMのPhi-3ファミリーの1モデルです。こちらはローカルで稼働する軽量モデルで、以下のスペックを持ち合わせています。(※8)

- コンテキストウィンドウは128kトークン

- 数学・コード・論理問題…etc.複雑な推論に特化

- ファインチューニング(SFT)と強化学習(RLHF)で最適化

- 日本語対応

そのほかPhi-3ファミリーからは、処理をより効率化した「Phi3.5 MoE」やマルチモーダル対応の「Phi 3.5 Vision Instruct」といったLLMも登場しています。

なお、Phi 3.5について詳しく知りたい方は、以下の記事をご確認ください。

ローカルLLMを使用して業務を効率化しよう

ローカルLLMは、自社サーバーやPCなどのローカル環境上でタスクを処理できるため、セキュリティを強化できるメリットがあります。

ローカルLLMとして混同されがちですが、オンプレミスにLLMを入れるのと、個人のコンピュータにローカルLLMを入れるのでは大きく意味が異なります。

- オンプレ環境に生成AIを導入する場合

→企業の内部ネットワークに生成AIを設置し、専用のサーバーで運用します。 - 個人のコンピュータにローカルLLMを導入する

→個人のPCに軽量なAIモデルをインストールし、手軽に利用します。

ローカルLLMの導入は3ステップで完了します。

- ローカルLLMを実行するためのプログラムをインストールする

- LLMを自身のPCもしくは自社サーバーにインストールする

- 1でインストールしたプログラムで2のLLMを指定してプロンプトを入力する

生成AIで業務を効率化しつつ、セキュリティ面も万全にしておきたい方は、ぜひローカルLLMを導入しましょう。

生成系AIの業務活用なら!

・生成系AIを活用したPoC開発

・生成系AIのコンサルティング

・システム間API連携

最後に

いかがだったでしょうか?

ローカルLLMを導入することで、自社の機密情報を安全に処理し、コストやコンプライアンスの課題も解決できます。業務に最適なモデル選定や運用方法をサポートし、効果的な活用を実現しましょう。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、サービス紹介資料もご用意しておりますので、併せてご確認ください。

︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。